Ý cấm OpenAI cung cấp quyền truy cập chatbot ChatGPT trong nước

Ở Mỹ và trên khắp châu Âu, các cơ quan quản lý đang kêu gọi điều chỉnh các công cụ AI tạo sinh để giải quyết các mối lo ngại từ an toàn dữ liệu, thông tin sai lệch.

Cơ quan quản lý quyền riêng tư của Ý (Garante) đã tạm thời cấm Chat GPT của OpenAI vì cho rằng, công cụ này đang thu thập và lưu trữ thông tin không đúng cách và tạo ra những khó khăn cho các nhà hoạch định chính sách khi đưa ra quy tắc AI mới.

Ở Mỹ và trên khắp châu Âu, các cơ quan quản lý đang kêu gọi điều chỉnh các công cụ AI tạo sinh để giải quyết các mối lo ngại từ an toàn dữ liệu, thông tin sai lệch cho đến an toàn việc làm. Sau quyết định của Garante, Italy trở thành quốc gia phương Tây đầu tiên chống lại ChatGPT. Trước đó siêu AI này đã bị cấm ở Trung Quốc, Hong Kong, Iran, Nga và một số khu vực của châu Phi.

Garante cáo buộc OpenAI không kiểm tra độ tuổi người dùng ứng dụng. Do vậy, trẻ em đối mặt với “những câu trả lời (của ChatGPT) hoàn toàn không phù hợp với mức độ phát triển và khả năng tự nhận thức của chúng”.

Ngoài ra, ứng dụng cũng "không có bất kỳ cơ sở pháp lý nào biện minh cho việc thu thập, lưu trữ dữ liệu cá nhân khổng lồ" để huấn luyện chatbot. OpenAI có 20 ngày để phản hồi bằng các biện pháp khắc phục. Nếu không công ty có thể bị phạt 20 triệu euro (tương đương 21,68 triệu USD) hoặc 4% doanh thu hàng năm trên toàn cầu.

OpenAI xác nhận đã vô hiệu hóa ChatGPT cho người dùng ở Italy theo yêu cầu của Garante. "Chúng tôi tích cực phối hợp để hạn chế dữ liệu cá nhân trong quá trình đào tạo ChatGPT. Chúng tôi muốn AI tìm hiểu về thế giới chứ không phải về các ngóc ngách cá nhân", công ty nói thêm.

Vào tuần trước, Cơ quan giám sát của Ý đã mở một cuộc điều tra về OpenAI liên quan đến các vi phạm an ninh mạng, trong đó có việc mọi người được xem đoạn trích các cuộc hội thoại ChatGPT của người dùng khác và thông tin tài chính của họ. Theo đó, dữ liệu người dùng đã bị lộ bao gồm họ và tên, địa chỉ thanh toán, loại thẻ tín dụng, ngày hết hạn của thẻ tín dụng và bốn chữ số cuối của thẻ tín dụng của họ (theo nội dung một email do OpenAI gửi cho một khách hàng bị ảnh hưởng).

Các công cụ như ChatGPT, được đào tạo dựa vào hàng tỉ tài liệu từ khắp nơi trên mạng Internet, đang chịu sự giám sát gắt gao. Đầu tuần này, một nhóm các nhà nghiên cứu AI và lãnh đạo trong ngành công nghệ, bao gồm tỉ phú Elon Musk, kêu gọi tạm dừng đào tạo thế hệ công cụ AI tiếp theo trong sáu tháng để ngành công nghiệp này có thời gian thiết lập các tiêu chuẩn an toàn.

Trong khi đó, các nhà xuất bản tin tức bắt đầu kiểm tra xem các công ty như OpenAI sử dụng nội dung của họ ở mức độ nào để đào tạo những công cụ chatbot như ChatGPT. Trên cơ sở đó, họ có thể theo đuổi các biện pháp pháp lý để yêu cầu bồi thường.

EU đang tiến sắp hoàn tất thảo luận một dự luật, được đề xuất vào năm 2021, để quản lý việc sử dụng AI trên toàn khối. Dự luật dự kiến bao gồm quy định cấm sử dụng nhận dạng khuôn mặt và có thể yêu cầu các nhà sản xuất công cụ như ChatGPT đánh giá rủi ro và xác minh chất lượng dữ liệu họ sử dụng để đào tạo phần mềm AI của họ.

Vương quốc Anh trong tuần này đã phát hành sách trắng đề xuất cách nước này có thể trao quyền cho các cơ quan quản lý giám sát sự phát triển của AI, tập trung vào các vấn đề như an toàn, minh bạch của công cụ.

Một số doanh nghiệp và tổ chức khác, bao gồm cả JPMorgan Chase & Co. trong những tháng gần đây đã chặn quyền truy cập vào Chat GPT từ hệ thống mạng cục bộ của mình. Verizon Communications Inc.- một tập đoàn viễn thông đa quốc gia của Mỹ, cho biết họ làm như vậy vì lo ngại mất quyền sở hữu dữ liệu độc quyền.

ChatGPT là chatbot AI được phát triển dựa trên mô hình ngôn ngữ lớn GPT-3.5. Ngày 14/3, thế hệ GPT-4 được công bố với khả năng xử lý đa phương thức đầu vào, trong đó có hình ảnh, giúp người dùng tương tác với nhiều chế độ. Việc chấp nhận hình ảnh đầu vào và xuất ra văn bản là tính năng mới chưa có trước đây, được đánh giá giúp người dùng có thêm tùy chọn để sáng tạo.

Bất chấp sức hút của ChatGPT, giới chuyên gia liên tục cảnh báo rủi ro liên quan đến AI này. Sam Altman, CEO OpenAI, cũng cho biết, kết quả đầu ra của ChatGPT chứa nhiều lỗi. "Nó biết rất nhiều, nhưng điều nguy hiểm là nó tự tin và sai một phần đáng kể", ông viết trên Twitter. Mira Murati, CTO OpenAI, cũng đánh giá điểm yếu của ChatGPT là "có thể bịa ra sự thật, không phải lúc nào câu trả lời của AI cũng đúng".

Thu Hà (t/h)

Cùng chuyên mục

TikTok để lại 'miếng bánh' tỷ USD nếu rút khỏi thị trường Mỹ

Microsoft phát triển mô hình ngôn ngữ lớn riêng cho AI

Apple bị cáo buộc lấy cắp công nghệ từ các nhà cung cấp

Samsung "đá xéo" đối thủ Apple về lỗi tính năng báo thức trên iPhone

Nhật Bản phát triển thiết bị không dây 6G nhanh gấp 20 lần so với 5G

-

Tổng Giám Đốc FPT Smart Cloud Lê Hồng Việt: AI là một cơ hội lớn cho doanh nghiệp và xã hội

-

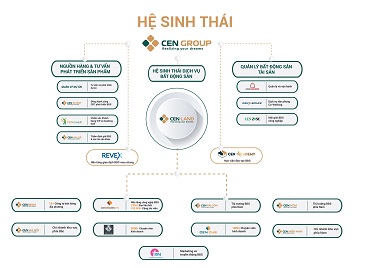

Vay ngân hàng mua bất động sản trong giai đoạn lãi suất thấp: Nên hay không?

-

Chuyên gia ‘hiến kế’ để phiên đấu thầu vàng thành công

-

TS. Trần Xuân Lượng: Hành vi người mua nhà đã thay đổi theo phân khúc căn hộ chung cư

-

Hoàn thiện thể chế để mở đường cho doanh nghiệp vượt khó, phát triển